初心者向け🔰 AI学習 解説(対策付)

クローラーとスクレイピング

技術的な専門知識のないクリエイター向けに、「AI学習ってどうなってんの?」をできる限り噛み砕いて解説する4コマ漫画を描いてみました。

よく生成AIの話題で登場する「クローラー」「スクレイピング」などの専門用語、それぞれどんな違いがあるのか知らない方の方が多いと思ったので、手始めにそこから4コマにしています。Qiitaなどの技術系記事を参考にしつつ、どこまで噛み砕いたら分かりやすいか模索しながら描いたので、かなり超要約版です。

是非ご覧いただいて、今後のAI学習からの自衛策の模索に役立てていただけると嬉しいです。

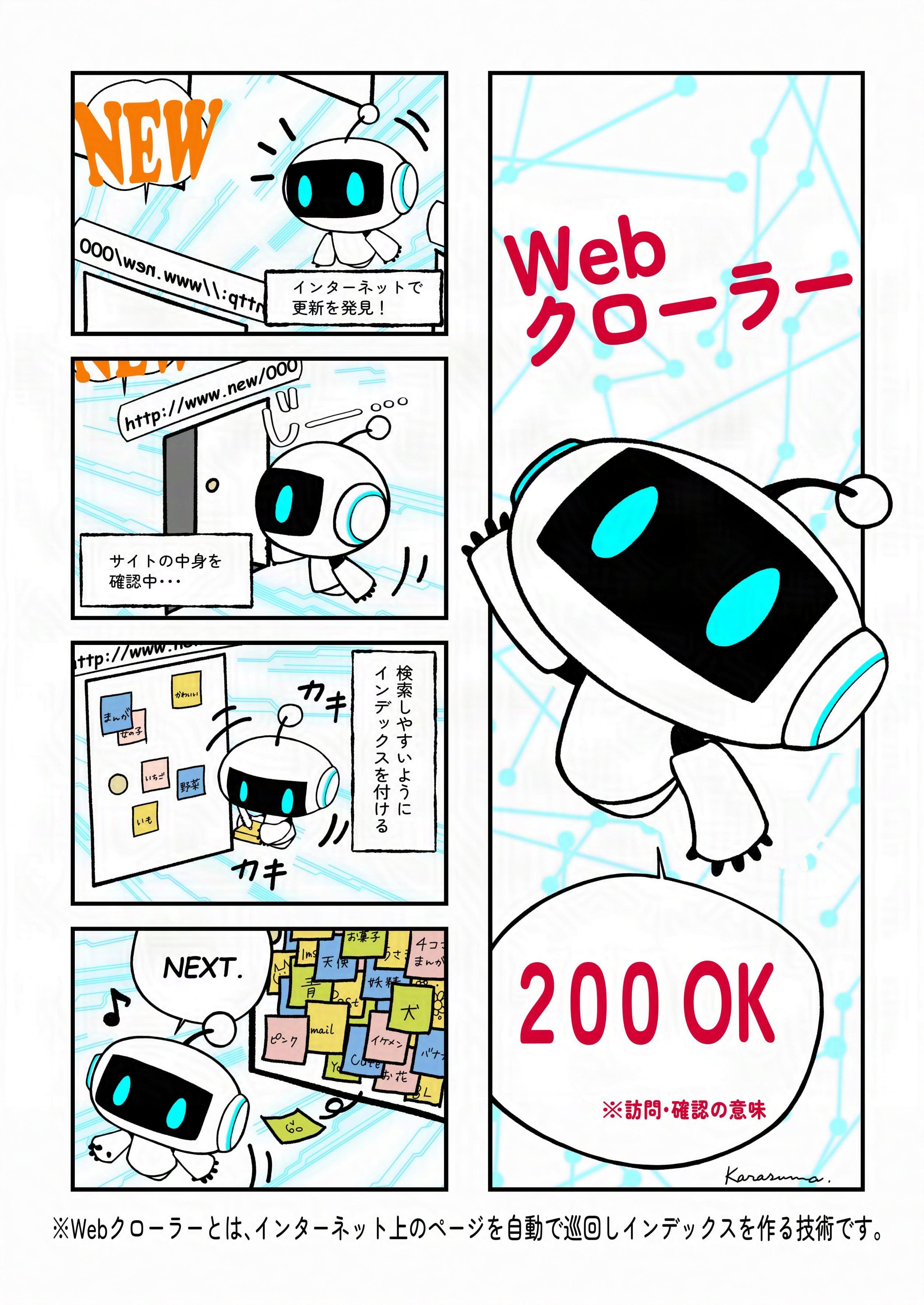

① Webクローラーとは

わかりやすい例で挙げると、Google検索などの「検索」で使用されている仕組みです。インターネット上のページを自動で巡回し、インデックス(目次)を作る技術です。データを持ち帰るわけではなく、「ここにこういうページがある」という情報を記録して去っていくだけです。

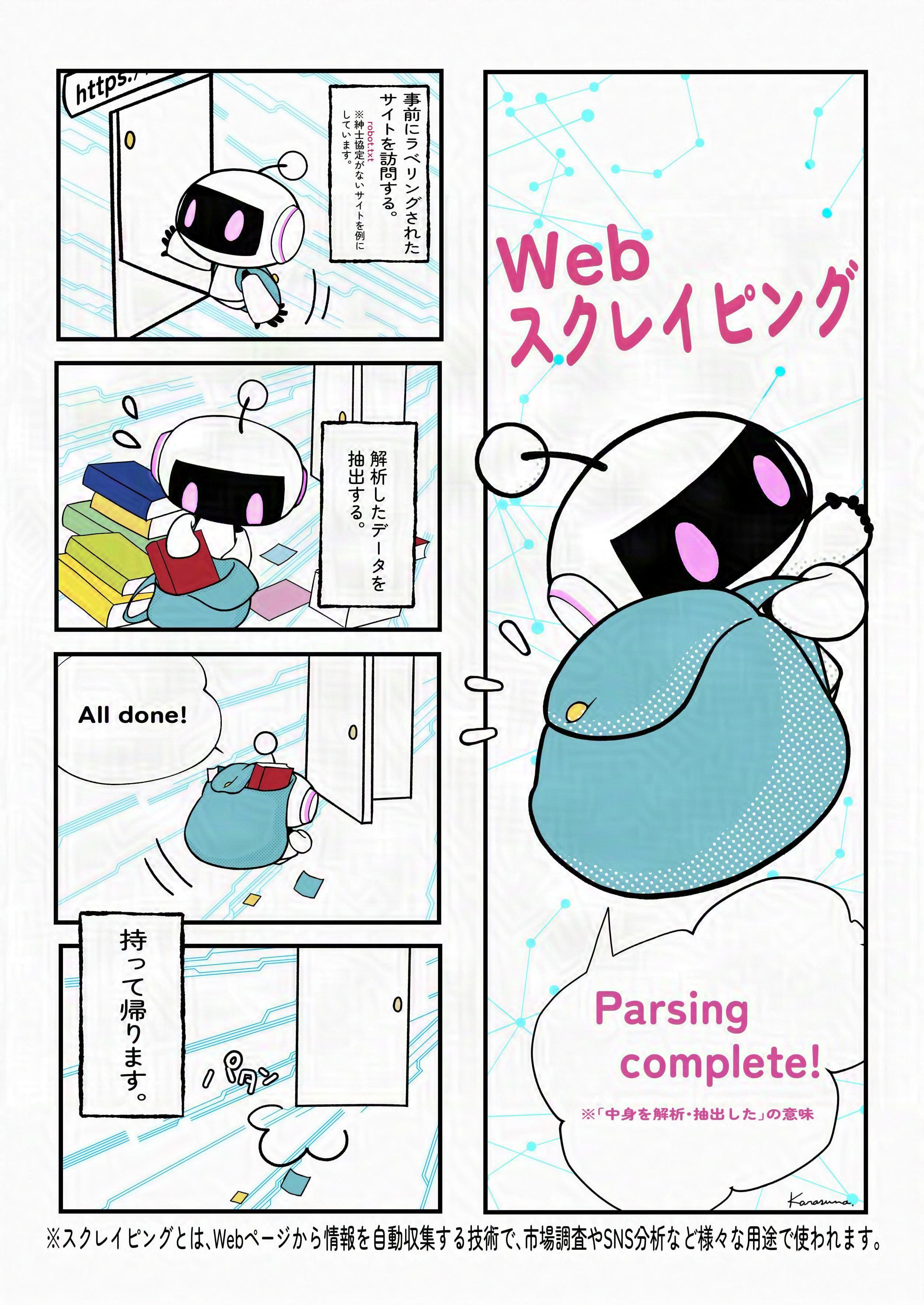

② スクレイピングとは

様々な用途があって、SNSを始めとしたプラットフォーム・WebページからSNS投稿や商品価格など沢山の情報収集を自動的に行い、マーケティングなど様々な用途で活用されている技術です。クローラーと違い、データを実際に「持ち帰る」のがポイントです。AI学習に使われるのはこの段階からで、スクレイピング単体でもAI学習以外の用途で以前から問題になることがある技術です。

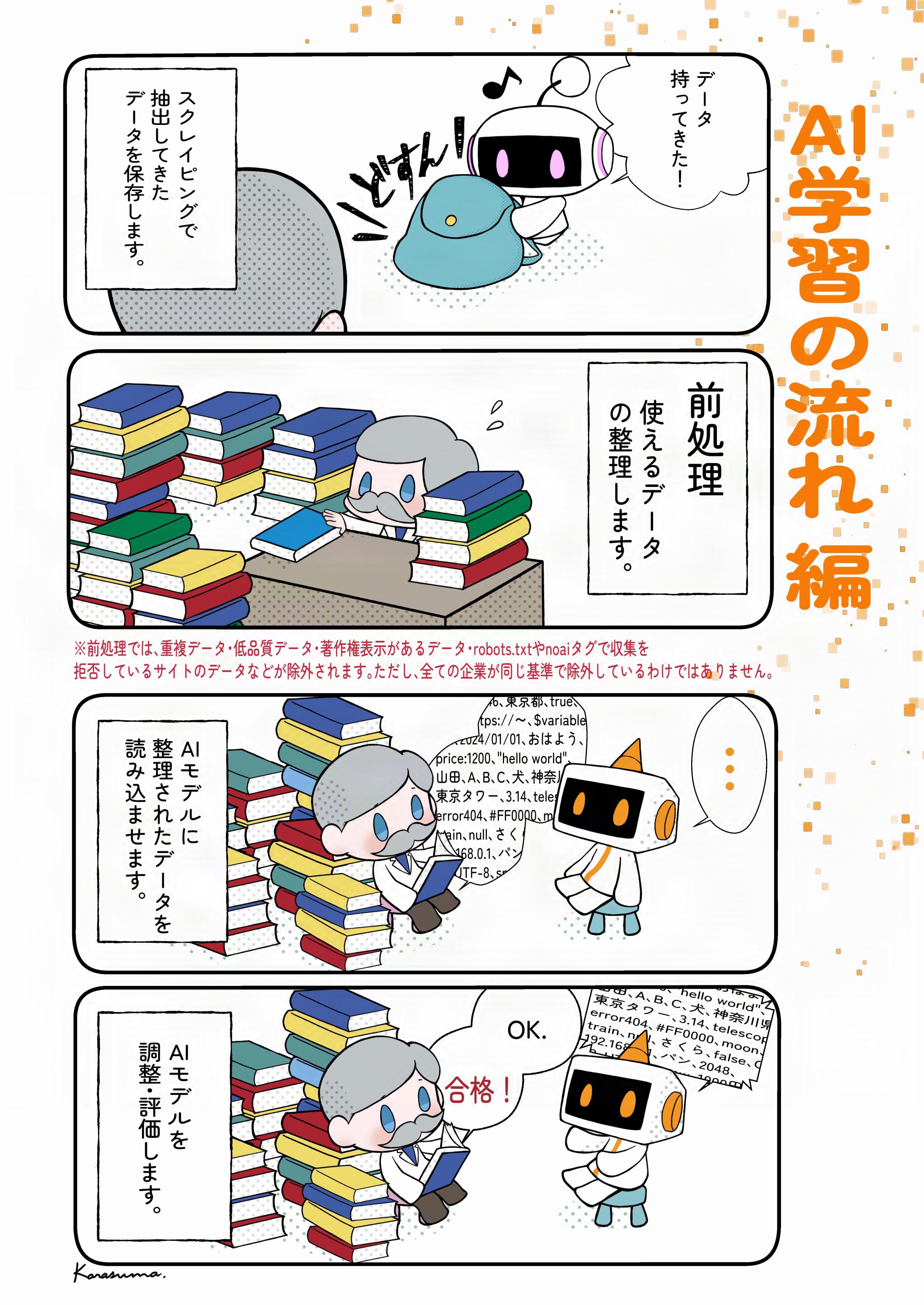

③ AI学習のざっくり流れ

AIモデルが作られるまでのざっくりした流れの解説です。スクレイピングで集めたデータをそのまま使うわけではなく、「前処理」という整理の工程が入ります。

2コマ目の「前処理」では、重複データ・低品質データ・著作権表示があるデータ・robots.txtやnoaiタグで収集を拒否しているサイトのデータなどを除外する企業もあります。ただし弾かない企業も多く、企業によって扱いが異なるため基準は定められていません。

メタデータへの著作者情報の書き込みという手段も存在します。Adobe Content Authenticity Beta(Adobe社)やYuify(Wacom社)が現在利用可能です。また、ERC-7517というデジタル資産のAI学習利用範囲をメタデータで指定できる仕組みも提案されています。(2026年3月現在、Draft段階)

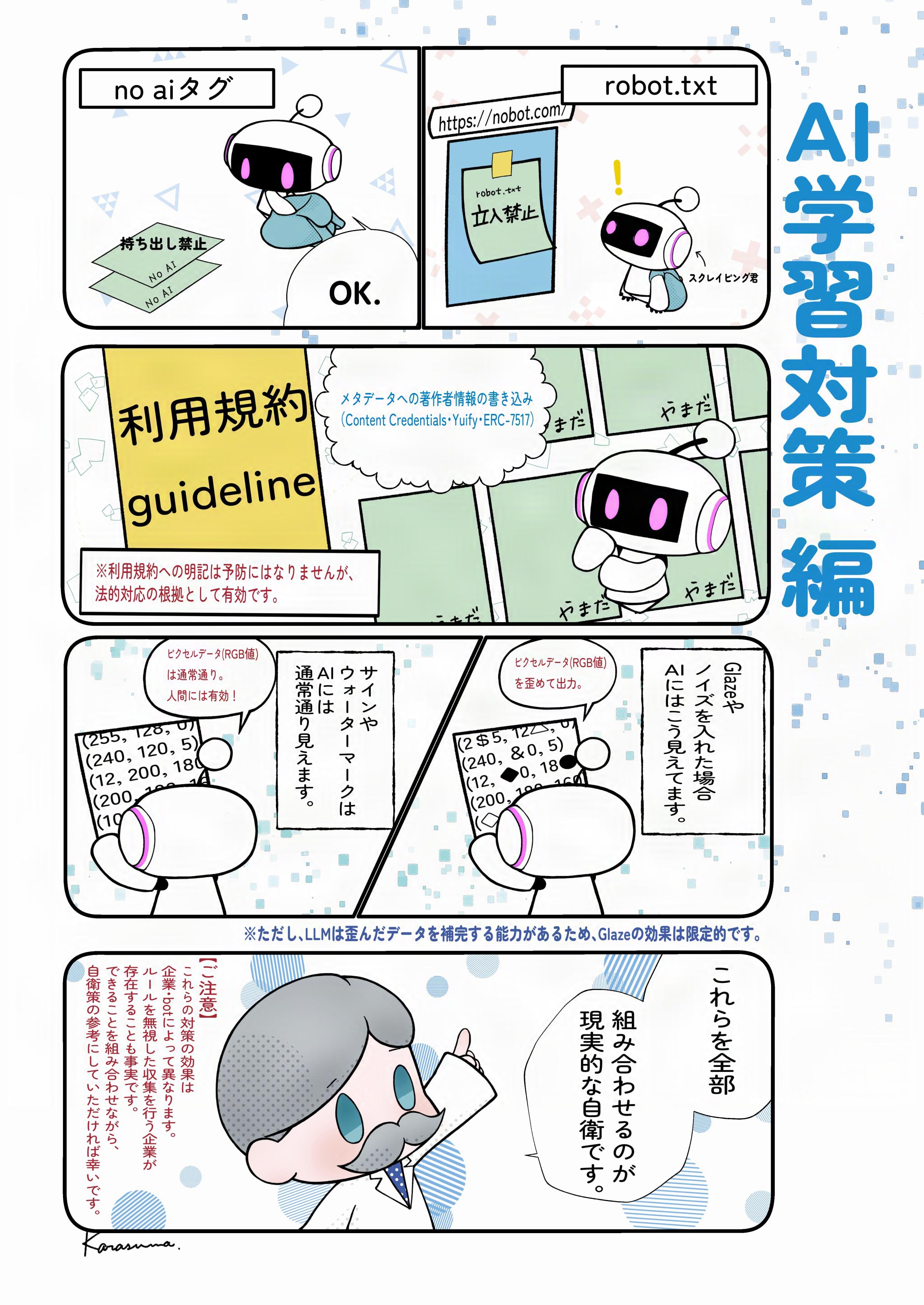

④ AI学習 対策案(2026年3月末現在)

robots.txtはWebサイト管理では一番有名な「botお断り紳士協定」とされています。ただしあくまでも「紳士協定」なので、普通に破ってくるAI開発企業も多いのが現状です。サーバー上でIP単位でブロックすることも可能ですが、費用が嵩む場合があります。

サイン・ウォーターマークは人間への抑止・トレース手段として有効です。サインを無断で消す行為は多くの国で著作者の権利侵害にあたり、消去・複製が立証できる場合は法的追及の可能性が高まります。ただしAI学習への対策としては現状では確実ではありません。また、LLMは歪んだデータを補完する能力があるため、Glazeのようなノイズ付与の効果も限定的です。

2026年4月1日より未管理著作物裁定制度が開始されました。ウォーターマークに個人への連絡先を入れることも有効ではないかと個人的に考えています。

様々な対策はいたちごっこのように次々に破られるのが常なので、可能な限り多層で防御策を立てておくことが望ましいと思われます。対策の効果は企業・botによって異なります。ルールを無視した収集を行う企業が存在することも事実です。できることを組み合わせながら、自衛策の参考にしていただければ幸いです。